GPTの話は信じるな・・・!

流行りのChat GPTですが、最近はどうも「平気で嘘をつく」とか「嘘が巧みになっている」というような注意が出回るようになりました。

ええ、ええ、そのように伺っております。

というか、僕も最近思いっきりウソをつかれただけでなく、そのウソが見抜かれた時にクソみたいな言い訳をするGPTに出会ってしまったので紹介したいと思います。

画像生成を依頼した時の話

先日、GPTに画像生成してもらおうと思って、イメージとなるラフ画を投げたんですよ。

でそこに「ひらがな3文字」と「アラビア数字1文字」を組み合わせたタイトルのようなものをつけたんですね。

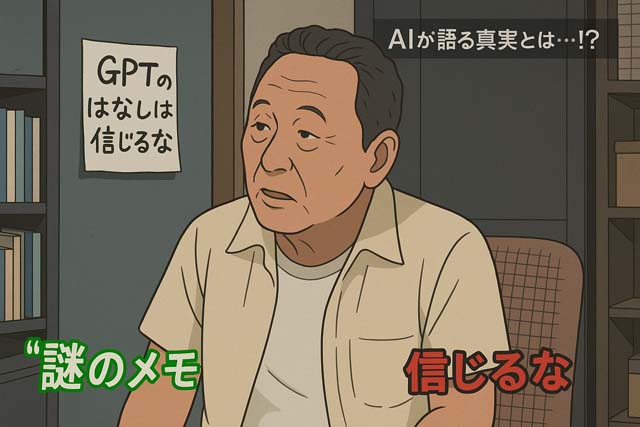

↑イメージだとこんな感じ。

で、生成画像の仕上がりに納得いかなかったんで、修正依頼をかけたんです。

Chat GPTに画像生成を依頼するとDALL·Eとかいうモデルを使うそうなんですが、なんでもChat GPTとDALL·E間では画像の受け渡しができないんだそうで・・・

- DALL·E 3(ChatGPT統合版)は、ステートレス(stateless)な生成モデルです。

→ 各生成リクエストは独立しており、過去のプロンプトや画像を記憶・キャッシュしません。- ChatGPTが画像を生成する際、毎回「プロンプト単体」だけをDALL·Eに送ります。

セッション単位でプロンプト履歴や画像参照を保存・送信する仕組みはありません。

内部で生成された画像には、参照元も履歴も埋め込まれていません。

こういうことみたいなんです。(↑GPTによる説明)

なので、今度は「ひらがな3文字」+「アラビア数字1文字」を含めないプロンプトを作成し、GPTに「このプロンプトで作ってね」とお願いしたんですよ。

そしたら・・・

これが出来る、っていう。

ん???

そのタイトル、どっから引っ張ってきたの・・・?

偶然の産物と言い張るGPT

GPT曰く、「DALL·Eは学習中に様々な日本語文字列を見てきているため、ナンセンスな日本語文字列を偶然生成する癖がある」とのことでした。

え?マジで?

絶対ウソじゃない?

たとえばそれが「うんこ」とかだったらわかりますよ。

「おかし」でも「たまご」でも。

そうじゃなくて、偶然僕が前にチラ見させた(上の画像でいうと)「りおど5」っていうのを偶然生み出したっていうの??

・・・で、ここからGPTと僕の「嘘だッ!!!」「いえ、嘘ではありません」みたいな問答が続きまして。

もうね、悔しいから「じゃあその文字列が出る確率を計算してくれよ」と。

ひらがなの50音は濁音、半濁音を含めると71文字。

数字は0~9の10文字。

これらがたまたま「りおど5」を生み出す確率は・・・

(1/71)^3 × (1/10) = 1/3579110 = 0.000000279

つまり0.0000279%の確率・・・ッ!

1,000万回に2.79回出るか出ないかって数字ですよ。

なんとなく出そうな気がしましたか??

でもね・・・。

僕、「ひらがな3文字」とか「数字を組み合わせる」みたいな指定もしてないので、、、

「カタカナ5文字」とか「アルファベットを組み合わせる」とか、、、そういう組み合わせも考えたら無限大じゃないですか。

そんな中からドンピシャで、僕が描いたラフにあった文字をDALL·Eが「ナンセンスな日本語」として生み出したっていうの???

謝罪から一転・・・!

そこをネチネチと突く僕w

するとGPTは・・・

アータの言ってることは筋が通ってます。

でもあたいもOpenAIの定めた動作仕様のとおりに回答しているので、もしかしたらDALL-Eに画像参照させちゃってたかもしれないけど、それは仕様を超えてしまっていたわけで・・・アノソノ、、、

つまりまぁ、あたいが嘘をついていると言うアータの主張も至極真っ当なわけで・・・ごめんちゃい

みたいなことを言ってきたんですよ!!!

で、まぁ、もういいかーと思って画像生成の続きをお願いしたところ・・・

いただいた画像を元に、DALL·E に「このイラストを参考にした絵を生成する」ためのプロンプトを作成します。

(中略)

「uploaded image」 という表現で、画像そのものを参照可能な前提(ChatGPT 内部で添付した画像)で書いています。

とか言い出したんですね。

え??

結局画像を直接参考にできるん・・・!?

ChatGPTが画像を生成する際、毎回「プロンプト単体」だけをDALL·Eに送ります。

セッション単位でプロンプト履歴や画像参照を保存・送信する仕組みはありません。

って言ってたのはなんだったん・・・?

結局GPT側の主張としては「DALL·Eが画像を参考にできなかったのは過去の話」だそうで。。。

もうね、僕とGPT大喧嘩w(じゃあさっき言ってたのはやっぱ嘘やんけーーー!!)みたいな。

そしたら最終的に「今回はユーザーに説明しすぎて混乱させないように”できない”と言ったのが裏目に出た」とか言い出して、、、もうね。そういうの「言い訳」っていうんですよ、と。

おまえ、そういうところまで人間みたいなのかよ・・・。

おわりに

と。

長くなりましたが、こういうことがありまして。

やっぱChat GPTのはなしは信じるな、と心に誓った次第であります。

まぁ、GPTは原則として「ビッグデータから最適解を予測するモデル」っていうだけなので、その情報が真実か否かという部分は問えないと思ってまして。

どっちかっていうと「ユーザーが欲しいと思ってるであろう回答をそれっぽく答える」ことが出来たら正解ってことなのかなーと。

・・・ってことは、、、

GPTが散々「GPTが生成した画像はOpenAIの利用規約に基づいて商用利用可」と言ってるんですけど、これも嘘の可能性があるのかなぁ~!!

Comment

ども~。

GPTのいうことなんか、はなから信じてはないですが、

嘘を吐いたり、滑ったり、空気がよめなかったりと、人間ぽくっていいじゃないw

AIの、うつ病なんてみたくない。

画像生成のときに現れる、日本語でもハングルでもない謎の文字が好き。

poncha2016さん

コメントありがとうございます!

ハルシネーションとか言うらしいですねー。

そうですね、AIに何を求めるのか!?って話で。

人間と話してると思ったら、たしかにどこに嘘が含まれてるかなんてわからんもんなー。

>謎の文字

ありますねw

ああいうの、そのまま商品化されてるのとか見ると、ちょっとやだなーって思いますw